Odată cu apariția tehnologiilor emergente precum deep learning, AI și ML, GPU-urile cloud sunt la mare căutare.

Dacă organizația dvs. se ocupă de vizualizări 3D, învățare automată (ML), inteligență artificială (AI) sau calcule grele de orice fel, modul în care efectuați calculul GPU contează foarte mult.

În mod tradițional, modelele de învățare profundă din organizații au luat o cantitate mare de timp pentru sarcinile de instruire și calcul. Obișnuia să le ucidă timpul, îi costa mult și îi lăsa cu probleme de stocare și spațiu, reducând productivitatea.

GPU-urile new age sunt concepute pentru a rezolva această problemă. Ele oferă o eficiență ridicată pentru a efectua calcule grele și antrenament mai rapid pentru modelele dvs. AI în paralel.

Conform cercetărilor Indigo, GPU-urile pot oferi de 250 de ori mai rapid performanță decât CPU-urile în timp ce antrenați rețele neuronale asociate cu învățarea profundă.

Iar odată cu progresul cloud computing-ului, avem acum GPU-uri cloud care transformă lumea științei datelor și a altor tehnologii emergente, oferind performanțe și mai rapide, întreținere ușoară, costuri reduse, scalare rapidă și economisire de timp.

Acest articol vă va prezenta conceptele GPU în cloud, cum se leagă cu AI, ML, învățarea profundă și unele dintre cele mai bune platforme GPU în cloud pe care le puteți găsi pentru a vă implementa GPU-ul cloud preferat.

Sa incepem!

Cuprins

Ce este un GPU cloud?

Pentru a înțelege un GPU în cloud, să vorbim mai întâi despre GPU-uri.

O unitate de procesare grafică (GPU) se referă la un circuit electronic specializat folosit pentru a modifica și manipula rapid memoria pentru a accelera crearea de imagini sau grafice.

GPU-urile moderne oferă o eficiență mai mare în manipularea procesării imaginilor și a graficii pe computer datorită structurii lor paralele decât unitățile centrale de procesare (CPU). Un GPU este încorporat pe placa sa de bază sau plasat pe placa video a unui PC sau pe matrița CPU.

Unitățile de grafică în cloud (GPU) sunt instanțe de computer cu accelerare hardware robustă, utilă pentru rularea aplicațiilor pentru a gestiona sarcinile de lucru masive de AI și de deep learning în cloud. Nu are nevoie să implementați un GPU fizic pe dispozitivul dvs.

Unele GPU-uri populare sunt NVIDIA, AMD, Radeon, GeForce și multe altele.

GPU-urile sunt utilizate în:

- Telefoane mobile

- Console de jocuri

- Stații de lucru

- Sisteme integrate

- Calculatoare personale

Pentru ce sunt folosite GPU-urile:

Iată câteva cazuri de utilizare ale GPU-urilor:

- În AI și ML pentru recunoașterea imaginilor

- Calcule pentru grafică pe computer 3D și desene CAD

- Maparea texturii și redarea poligoanelor

- Calcule geometrice precum translațiile și rotațiile vârfurilor în sisteme de coordonate

- Sprijină shadere programabile pentru a manipula texturi și vârfuri

- Codificare, decodare și streaming video accelerate de GPU

- Jocuri bogate în grafică și jocuri în cloud

- Modelare matematică la scară largă, analiză și învățare profundă care necesită capacități de procesare paralelă ale GPU-urilor de uz general.

- Editare video, proiectare grafică și creare de conținut

Care sunt beneficiile GPU-urilor cloud? 👍

Avantajele cheie ale utilizării GPU-urilor Cloud sunt:

Foarte scalabil

Dacă doriți să vă extindeți organizația, volumul de lucru al acesteia va crește în cele din urmă. Veți avea nevoie de un GPU care se poate scala cu volumul de lucru crescut. GPU-urile cloud vă pot ajuta să faceți acest lucru, permițându-vă să adăugați mai multe GPU-uri cu ușurință, fără probleme, astfel încât să vă puteți îndeplini sarcinile de lucru crescute. În schimb, dacă doriți să reduceți, acest lucru este posibil și rapid.

Minimizează costul

În loc să cumpărați GPU-uri fizice de mare putere, care costă incredibil de mare, puteți alege GPU-uri în cloud pe o închiriere care este disponibilă la un cost mai mic pe oră. Vei fi taxat pentru numărul de ore în care ai folosit GPU-urile cloud, spre deosebire de cele fizice care te-ar fi costat mare deși nu le folosești prea mult.

Șterge resursele locale

GPU-urile cloud nu vă consumă resursele locale, spre deosebire de GPU-urile fizice care ocupă o cantitate semnificativă de spațiu pe computer. Ca să nu mai vorbim, dacă rulați un model ML la scară mare sau redați o sarcină, acesta încetinește computerul.

Pentru aceasta, puteți lua în considerare externalizarea puterii de calcul către cloud fără a vă stresa computerul și să-l utilizați cu ușurință. Folosiți doar computerul pentru a controla totul în loc să-i dați toată presiunea pentru a face față sarcinilor de lucru și a sarcinilor de calcul.

Salveaza timp

GPU-urile cloud oferă designerilor flexibilitatea iterației rapide cu timpi de randare mai rapidi. Puteți economisi mult timp prin finalizarea unei sarcini în minute, care obișnuia să dureze ore sau zile. Prin urmare, productivitatea echipei tale va crește semnificativ, astfel încât să poți investi timp în inovare în loc de randare sau calcule.

Cum ajută GPU-urile în Deep Learning și AI?

Învățarea profundă este baza inteligenței artificiale. Este o tehnică ML avansată care pune accent pe învățarea reprezentativă cu ajutorul rețelelor neuronale artificiale (ANN). Modelul de învățare profundă este utilizat pentru a procesa seturi mari de date sau procese foarte computaționale.

Deci, cum intervin GPU-urile în imagine?

GPU-urile sunt proiectate pentru a efectua calcule paralele sau mai multe calcule simultan. GPU-urile pot valorifica capacitatea modelului de învățare profundă pentru a accelera sarcinile de calcul mari.

Deoarece GPU-urile au multe nuclee, acestea oferă calcule excelente de procesare paralelă. În plus, au o lățime de bandă de memorie mai mare pentru a găzdui cantități masive de date pentru sistemele de învățare profundă. Prin urmare, acestea sunt utilizate pe scară largă pentru antrenarea modelelor AI, redarea modelelor CAD, jucarea de jocuri video bogate în grafică și multe altele.

Mai mult, dacă doriți să experimentați cu mai mulți algoritmi simultan, puteți rula mai multe GPU-uri separat. Facilitează diferite procese pe GPU-uri separate fără paralelism. Pentru aceasta, puteți utiliza mai multe GPU-uri pe diferite mașini fizice sau într-o singură mașină pentru a distribui modele de date grele.

Cum puteți începe cu Cloud GPU

Începerea cu GPU-urile cloud nu este știință rachetă. De fapt, totul este ușor și rapid dacă poți înțelege elementele de bază. În primul rând, trebuie să alegeți un furnizor de GPU în cloud, de exemplu, Google Cloud Platform (GCP).

Apoi, înscrieți-vă la GCP. Aici, puteți profita de toate beneficiile standard care vin cu acesta, cum ar fi funcțiile cloud, opțiunile de stocare, gestionarea bazelor de date, integrarea cu aplicații și multe altele. De asemenea, puteți folosi Google Colboratory care funcționează ca Jupyter Notebook pentru a utiliza un GPU GRATUIT. În cele din urmă, puteți începe să redați GPU-uri pentru cazul dvs. de utilizare.

Deci, să ne uităm la diferite opțiuni pe care le aveți pentru GPU-urile cloud pentru a gestiona AI și sarcinile masive de lucru.

Linode

Linode oferă GPU-uri la cerere pentru sarcini de procesare paralelă, cum ar fi procesarea video, calculul științific, învățarea automată, AI și multe altele. Oferă mașini virtuale optimizate pentru GPU accelerate de NVIDIA Quadro RTX 6000, Tensor, nuclee RT și valorifică puterea CUDA pentru a executa sarcini de lucru de ray tracing, învățare profundă și procesare complexă.

Transformă-ți cheltuiala de capital în cheltuieli de exploatare, luând acces de la Linode GPU pentru a profita de puterea GPU-ului și a beneficia de propunerea de valoare reală a cloud-ului. În plus, Linode vă permite să vă concentrați asupra competențelor de bază în loc să vă faceți griji pentru hardware.

GPU-urile Linode elimină bariera de a le folosi pentru cazuri complexe de utilizare, cum ar fi streaming video, AI și învățarea automată. În plus, veți primi până la 4 cărți pentru fiecare caz, în funcție de puterea de care aveți nevoie pentru sarcinile de lucru proiectate.

Quadro RTX 6000 are 4.608 nuclee CUDA, 576 nuclee Tensor, 72 nuclee RT, 24 GB memorie GPU GDDR6, 84T RTX-OPS, 10 Giga Rays/sec Rays Cast și performanță FP32 de 16,3 TFLOP.

Prețul pentru planul GPU dedicat plus RTX6000 este de 1,5 USD/oră.

Paperspace CORE

Încărcați-vă fluxul de lucru organizațional cu infrastructura de calcul accelerată de nouă generație prin Paperspace CORE. Oferă o interfață simplă și ușor de utilizat pentru a oferi o integrare simplă, instrumente de colaborare și aplicații desktop pentru Mac, Linux și Windows. Folosiți-l pentru a rula aplicații cu cerere mare prin putere de calcul nelimitată.

CORE oferă o rețea rapidă, furnizare instantanee, suport pentru aplicații 3D și API completă pentru acces programatic. Obțineți o vedere completă a infrastructurii dvs. cu o interfață grafică intuitivă și fără efort într-un singur loc. În plus, obțineți un control excelent cu interfața de gestionare a CORE, care include instrumente robuste și vă permite să filtrați, sortați, conectați sau creați mașini, rețele și utilizatori.

Consola de management puternică a CORE realizează rapid sarcini precum adăugarea integrării Active Directory sau VPN. De asemenea, puteți gestiona cu ușurință configurațiile complexe ale rețelei și puteți finaliza lucrurile mai rapid în câteva clicuri.

În plus, veți găsi multe integrări care sunt opționale, dar utile în munca dvs. Obțineți funcții de securitate avansate, drive-uri partajate și multe altele cu această platformă GPU în cloud. Bucurați-vă de GPU-urile cu costuri reduse obținând reduceri pentru educație, alerte de facturare, facturare pentru o secundă etc.

Adăugați simplitate și viteză fluxului de lucru la un preț de pornire de 0,07 USD/oră.

GPU-uri Google Cloud

Obțineți GPU-uri de înaltă performanță pentru calcul științific, vizualizare 3D și învățare automată GPU-uri Google Cloud. Poate ajuta la accelerarea HPC, la selectarea unei game largi de GPU-uri pentru a se potrivi cu punctele de preț și performanța și la minimizarea volumului de lucru cu personalizări ale mașinii și prețuri flexibile.

De asemenea, oferă multe GPU-uri precum NVIDIA K80, P4, V100, A100, T4 și P100. În plus, GPU-urile Google Cloud echilibrează memoria, procesorul, discul de înaltă performanță și până la 8 GPU-uri în fiecare caz pentru sarcina de lucru individuală.

În plus, aveți acces la rețele, analize de date și stocare de vârf în industrie. Dispozitivele GPU sunt disponibile numai în anumite zone din anumite regiuni. Prețul va depinde de regiune, de GPU-ul pe care îl alegeți și de tipul de mașină. Puteți calcula prețul definindu-vă cerințele în Calculatorul de prețuri Google Cloud.

Alternativ, puteți alege următoarele soluții:

Serviciu GPU elastic

Serviciu GPU elastic (EGS) oferă capabilități de calcul paralele și puternice cu tehnologia GPU. Este ideal pentru multe scenarii precum procesarea video, vizualizarea, calculul științific și învățarea profundă. EGS utilizează mai multe GPU-uri precum NVIDIA Tesla M40, NVIDIA Tesla V100, NVIDIA Tesla P4, NVIDIA Tesla P100 și AMD FirePro S7150.

Veți obține beneficii precum servicii și instruire online de deep learning, identificarea conținutului, recunoașterea imaginii și a vocii, codificare media HD, conferințe video, repararea filmului sursă și 4K/8K HD live.

În plus, obțineți opțiuni precum redarea video, finanțare computațională, predicția climatului, simularea coliziunilor, inginerie genetică, editare neliniară, aplicații de educație la distanță și proiectare inginerească.

- Instanța GA1 oferă până la 4 GPU-uri AMD FirePro S7150, 160 GB memorie și 56 vCPU. Conține 8192 de nuclee și 32 GB memorie GPU care funcționează în paralel și oferă 15 TFLOPS de precizie simplă și un TFLOPS de precizie dublă.

- Instanța GN4 oferă până la 2 GPU-uri NVIDIA Tesla M40, 96 GB memorie și 56 vCPU. Conține 6000 de nuclee și 24 GB memorie GPU care oferă 14 TFLOPS de precizie unică. În mod similar, veți găsi multe cazuri, cum ar fi GN5, GN5i și GN6.

- EGS acceptă 25 Gbit/s și până la 2.000.000 PPS de lățime de bandă a rețelei intern pentru a oferi performanța maximă de rețea necesară nodurilor de calcul. Are un cache local de mare viteză care este atașat cu SSD sau discuri ultra cloud.

- Unitățile NVMe de înaltă performanță gestionează 230.000 IOPS cu o latență I/O de 200 s și oferă 1900 Mbit/s lățime de bandă de citire și 1100 Mbit/s lățime de bandă de scriere.

Puteți alege dintre diferite opțiuni de cumpărare în funcție de nevoile dvs. pentru a obține resursele și a plăti doar pentru asta.

Seria Azure N

Seria Azure N dintre mașinile virtuale Azure (VM) au capabilități GPU. GPU-urile sunt ideale pentru grafică și încărcături de lucru intensive, ajutând utilizatorii să pregătească inovația prin diferite scenarii, cum ar fi învățarea profundă, analiza predictivă și vizualizarea de la distanță.

Serii N diferite au oferte separate pentru sarcini de lucru specifice.

- Seria NC se concentrează pe învățarea automată de înaltă performanță și pe sarcinile de lucru de calcul. Cea mai recentă versiune este NCsv3, care dispune de GPU-ul NVIDIA Tesla V100 de la NVIDIA.

- Seria ND se concentrează pe scenarii de inferență și antrenament în principal pentru învățarea profundă. Folosește GPU-uri NVIDIA Tesla P40. Cea mai recentă versiune este NDv2 care dispune de GPU-uri NVIDIA Tesla V100.

- Seria NV se concentrează pe vizualizarea de la distanță și pe alte sarcini de lucru intensive pentru aplicații susținute de GPU NVIDIA Tesla M60.

- Mașinile virtuale NC, NCsv3, ND și NCsv2 oferă interconexiune InfiniBand care permite performanța de extindere. Aici veți obține beneficii precum învățarea profundă, redarea grafică, editarea video, jocurile etc.

IBM Cloud

IBM Cloud vă oferă flexibilitate, putere și multe opțiuni GPU. Întrucât GPU-ul este puterea intelectuală suplimentară de care îi lipsește un procesor, IBM Cloud vă ajută să obțineți acces direct la selecția mai accesibilă a serverului pentru o integrare perfectă cu arhitectura, aplicațiile și API-urile IBM Cloud împreună cu o rețea distribuită a centrelor de date la nivel global.

- Veți obține opțiuni de GPU pentru server bare metal, cum ar fi Intel Xeon 4210, placă grafică NVIDIA T4, 20 de nuclee, 32 GB RAM, 2,20 GHz și lățime de bandă de 20 TB. În mod similar, aveți și opțiuni de Intel Xeon 5218 și Intel Xeon 6248.

- Pentru serverele virtuale, obțineți AC1.8×60 care are opt vCPU, 60 GB RAM, 1 x GPU P100. Aici veți obține și opțiunile AC2.8×60 și AC2.8×60.

Obțineți GPU-ul pentru server bare metal la un preț de pornire de 819 USD/lună și GPU pentru server virtual la un preț de pornire de 1,95 USD/oră.

AWS și NVIDIA

AWS și NVIDIA au colaborat pentru a oferi continuu soluții eficiente din punct de vedere al costurilor, flexibile și puternice bazate pe GPU. Include instanțele Amazon EC2 alimentate cu GPU NVIDIA și servicii precum AWS IoT Greengrass care se implementează cu module NVIDIA Jetson Nano.

Utilizatorii folosesc AWS și NVIDIA pentru stații de lucru virtuale, învățare automată (ML), servicii IoT și calcul de înaltă performanță. Instanțele Amazon EC2 care alimentează GPU-urile NVIDIA sunt responsabile pentru furnizarea de performanțe scalabile. Mai mult, utilizați AWS IoT Greengrass pentru a extinde serviciile cloud AWS la dispozitivele edge bazate pe NVIDIA.

GPU-urile NVIDIA A100 Tensor Core alimentează instanțele Amazon EC2 P4d pentru a oferi o rețea cu latență scăzută și un randament ridicat. În mod similar, veți găsi multe alte instanțe pentru scenarii specifice, cum ar fi Amazon EC2 P3, Amazon EC2 G4 etc.

Aplicați pentru perioada de încercare GRATUITĂ și experimentați puterea GPU-ului până la marginea din cloud.

OVHcloud

OVHcloud oferă servere cloud care sunt proiectate pentru a procesa sarcini de lucru paralele masive. GPU-urile au multe instanțe integrate cu procesoare grafice NVIDIA Tesla V100 pentru a satisface nevoile de deep learning și machine learning.

Acestea ajută la accelerarea calculului în domeniul calculului grafic, precum și al inteligenței artificiale. OVH colaborează cu NVIDIA pentru a oferi cea mai bună platformă accelerată GPU pentru calcul de înaltă performanță, AI și învățare profundă.

Utilizați cel mai simplu mod de implementare și întreținere a containerelor accelerate GPU printr-un catalog complet. Oferă una dintre cele patru carduri instanțelor direct prin PCI Passthrough, fără niciun strat de virtualizare pentru a dedica toate puterile utilizării tale.

Serviciile și infrastructurile OVHcloud sunt certificate ISO/IEC 27017, 27001, 27701 și 27018. Certificarile indică faptul că OVHcloud are un sistem de management al securității informațiilor (ISMS) pentru gestionarea vulnerabilităților, implementarea continuității afacerii, gestionarea riscurilor și implementarea unui sistem de management al informațiilor de confidențialitate (PIMS).

Mai mult, NVIDIA Tesla V100 are multe caracteristici valoroase, cum ar fi PCIe 32 GB/s, 16 GB HBM2 de capacitate, 900 GB/s lățime de bandă, precizie dublă-7 teraFLOP-uri, precizie simplă-14 teraFLOP și deep learning-112 teraFLOP.

GPU lambda

Antrenați modele de deep learning, ML și AI cu Lambda GPU Cloud și scalați de la o mașină la numărul total de VM în doar câteva clicuri. Obțineți cadre majore preinstalate și cea mai recentă versiune a stivei lambda care include drivere CUDA și cadre de deep learning.

Obțineți acces rapid la mediul de dezvoltare Jupyter Notebook pentru fiecare mașină rapid din tabloul de bord. Utilizați SSH direct cu una dintre cheile SSH sau conectați-vă prin intermediul terminalului web din tabloul de bord din cloud pentru acces direct.

Fiecare instanță acceptă maximum 10 Gbps de lățime de bandă între noduri, ceea ce permite antrenamentul dispersat cu cadre precum Horovod. De asemenea, puteți economisi timp în optimizarea modelului prin scalarea la numărul de GPU-uri pe o singură sau mai multe instanțe.

Cu Lambda GPU Cloud, puteți economisi chiar și 50% la calcul, reduceți TCO în cloud și nu veți primi niciodată angajamente pe mai mulți ani. Utilizați un singur GPU RTX 6000 cu șase VCPU-uri, 46 GiB RAM, 658 GiB stocare temporară la doar 1,25 USD/oră. Alegeți din multe cazuri în funcție de cerințele dvs. pentru a obține un preț la cerere pentru utilizarea dvs.

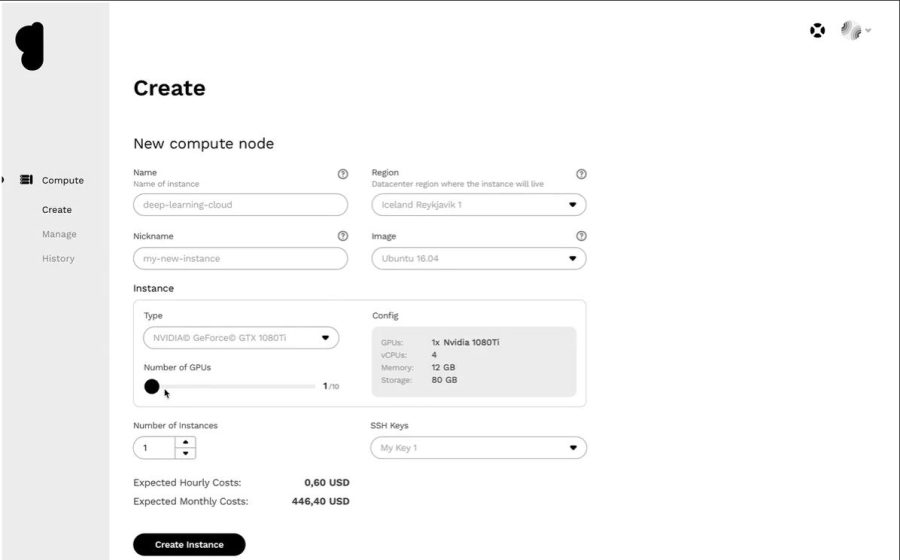

Genesis Cloud

Obțineți o platformă GPU cloud eficientă la un preț foarte accesibil de la Genesis Cloud. Au acces la multe centre de date eficiente de pe tot globul cu care colaborează pentru a oferi o gamă largă de aplicații.

Toate serviciile sunt sigure, scalabile, robuste și automatizate. Genesis Cloud oferă putere de calcul nelimitată pentru GPU pentru efecte vizuale, învățare automată, transcodare sau stocare, analiză Big Data și multe altele.

Genesis Cloud oferă GRATUIT multe funcții bogate, cum ar fi instantanee pentru salvarea muncii dvs., grupuri de securitate pentru traficul de rețea, volume de stocare pentru seturile mari de date, FastAI, PyTorch, imagini preconfigurate și un API public pentru TensorFlow.

Are GPU-uri NVIDIA și AMD de diferite tipuri. Mai mult, antrenați rețeaua neuronală sau generați filme animate valorificând puterea de calcul GPU. Centrele lor de date funcționează cu energie 100% regenerabilă din surse geotermale pentru a reduce emisiile de carbon.

Prețul lor este cu 85% mai mic decât alți furnizori, deoarece veți plăti pentru creșteri la nivel de minute. De asemenea, puteți economisi mai mult cu reduceri pe termen lung și preemptibile.

Concluzie 👩🏫

GPU-urile cloud sunt concepute pentru a oferi performanțe, viteză, scalare, spațiu și confort incredibile. Prin urmare, luați în considerare alegerea platformei dvs. GPU cloud preferate, cu capabilități ieșite din cutie, pentru a vă accelera modelele de deep learning și pentru a gestiona cu ușurință sarcinile de lucru AI.