Cuprins

Recomandări cheie

- Escrocheria cu clonarea vocii folosește inteligența artificială pentru a reproduce vocile în mod autentic, explodând emoțiile și urgența.

- Escrocii folosesc datele din rețelele sociale pentru a crea scenarii credibile și pentru a exploata legăturile personale.

- Fii precaut și învață semnele roșii ale înșelătoriilor cu clonarea vocii AI; Închideți apelurile și verificați mesajele de primejdie.

E noaptea târziu. Părinții tăi primesc un mesaj vocal de la tine plin de panică, în care se spune că ai probleme, ți-a fost furat portofelul și ești blocat în mijlocul neantului. Banii trebuie să-ți fie transferați imediat, astfel încât să poți ajunge acasă.

Vocea din mesaj sună atât de reală și este, fără îndoială, cea a copilului lor – doar că nu este. Este o clonă a vocii AI și au devenit ținta unei înșelătorii care este pe cât de modernă, pe atât de înfricoșător de eficientă.

Cum funcționează o înșelătorie de clonare a vocii AI?

Clonarea vocii poate crea replici digitale incredibil de realiste ale vocii unei persoane. Această tehnică, numită în mod obișnuit audio deepfake, este creat cu instrumente de clonare a vocii AI precum ElevenLabs (consultați exemplul de clonare a vocii AI de mai jos). Combinată cu IA generativă și sinteza vocii, vocea clonată poate reproduce emoții, nuanțe, intonație și chiar frică.

Și pentru referință, iată cum sună cu adevărat Christian Cawley, vorbind pe The Really Useful Podcast.

Pentru a crea o clonă de voce AI, este necesară doar un mic eșantion de voce – adesea doar un minut sau mai puțin. Mostre de voci sunt adesea preluate din postările publice de pe rețelele sociale, făcând bloggerii video și influenții deosebit de vulnerabili, deoarece calitatea audio a postărilor lor este de înaltă calitate și ușor disponibilă.

Odată ce escrocii clonează eșantionul de voce, ei folosesc text-to-speech sau chiar vorbire în timp real pentru a crea apeluri și mesaje vocale false.

După ce a accesat rețelele sociale ale victimei și și-a reunit detaliile personale, escrocul creează un scenariu credibil. Aceasta poate fi o spitalizare, o arestare, un furt, o răpire — orice crează frică. Vocea clonată este apoi folosită pentru a manipula un membru al familiei să creadă că persoana iubită are probleme serioase.

Realismul vocii și emoțiile, combinat cu șocul și urgența cererii, pot trece peste scepticismul, ducând la decizii pripite de a transfera bani sau de a furniza informații sensibile.

De ce sunt atât de eficiente înșelătoriile cu clonarea vocii AI

La fel ca majoritatea înșelătoriilor care vizează familia și prietenii, înșelătoria de clonare a vocii AI este eficientă, deoarece exploatează legăturile personale. Panica de a primi un apel de primejdie de la o persoană dragă poate întuneca rapid judecata, ducând la decizii pripite. Este aceeași tactică folosită în înșelătoriile Quid Pro, dar efectul este agravat de auzirea vocii cuiva apropiat.

Membrii familiei celor cu o prezență ridicată în rețelele sociale sau cei care călătoresc sunt în mod deosebit expuși riscului, deoarece situațiile lor oferă un context plauzibil pentru narațiunea inventată a escrocului. Escrocii vor colecta și vor folosi adesea datele private ale țintelor lor din conturile lor publice de pe rețelele sociale înainte de timp, făcând poveștile și mai convingătoare.

Semne cheie ale unei înșelătorii de clonare a vocii AI

În ciuda complexității lor, înșelătoriile clonelor de voce AI se pot dezvălui prin semnale roșii specifice:

- Urgență: escrocul vă va convinge că ceva groaznic se va întâmpla dacă nu se iau măsuri imediat.

- Fapte: Escrocii nu știu întotdeauna întreaga poveste din spatele relației tale cu ținta, așa că acordă atenție inconsecvențelor.

- Solicitări neobișnuite: solicitările de transfer de bani către conturi bancare de peste mări sau de plată către un portofel cu criptomonede sunt tactici obișnuite.

Este dificil să luați în considerare acești factori atunci când vi se prezintă un scenariu teribil, dar vă poate împiedica să fiți înșelat.

Ce trebuie să faceți dacă suspectați o înșelătorie cu clonarea vocii AI

Dacă primiți un apel sau un mesaj vocal de la cei dragi aflați în primejdie, rămâneți calm. Escrocii se bazează pe tine pentru a intra în panică și a deveni emoționali, deoarece acest lucru vă crește vulnerabilitatea la tacticile lor.

Dacă primiți un apel telefonic

Dacă bănuiți, chiar și pentru o secundă, că un apel poate fi o înșelătorie de clonare a vocii, închideți imediat apelul. Nu împărtășiți nicio informație și nu interacționați cu escrocii. În schimb, sunați pe persoana iubită înapoi la un număr cunoscut pentru a confirma autenticitatea apelului de urgență.

Conversarea în continuare cu escrocii poate risca ca vocea să fie înregistrată și clonată.

Dacă primiți un mesaj vocal

Dacă escrocii au lăsat un mesaj vocal, salvați imediat sunetul pe telefon sau laptop. Acest eșantion de sunet poate fi folosit într-un instrument de clasificare a vorbirii AI pentru a determina dacă este vorba despre o voce umană. Aceste clasificatoare de vorbire AI funcționează la fel ca detectoarele de scriere AI. Pur și simplu introduceți fișierul audio, iar clasificatorul îl va marca ca uman sau generat de AI.

Un instrument excelent pentru efectuarea acestei verificări este clasificatorul de vorbire ElevenLabs. ElevenLabs alimentează majoritatea platformelor de clonare AI, deci este un instrument ideal pentru a determina dacă o voce a fost clonată. Iată cum îl puteți folosi pentru a determina o voce clonată de AI:

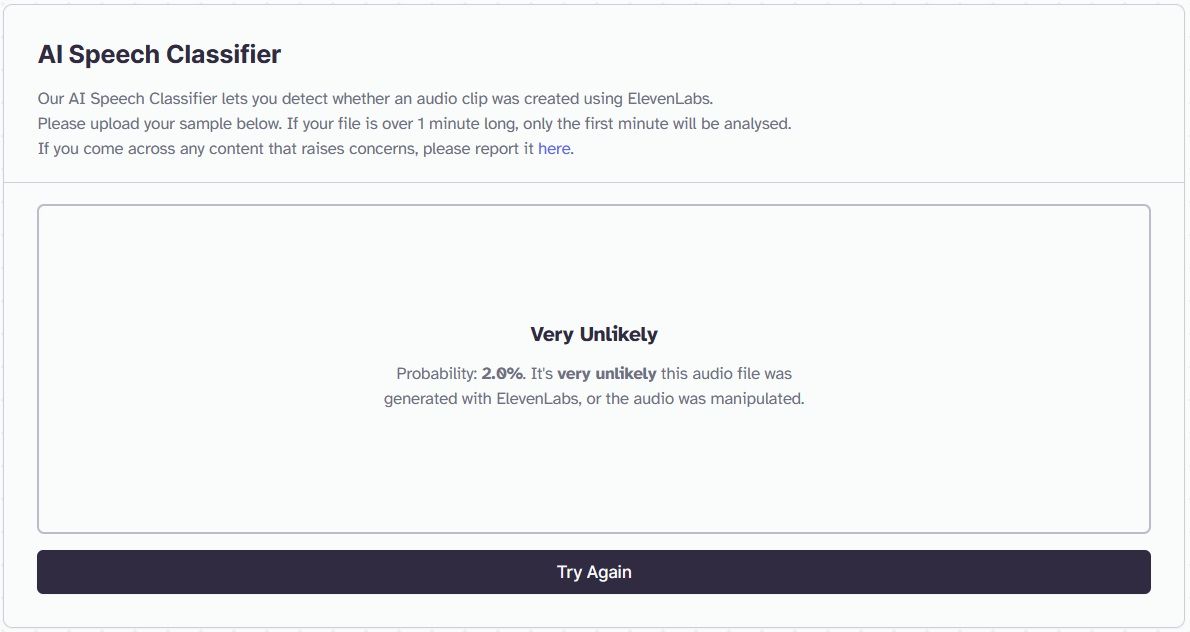

În exemplul de mai jos, un mesaj supărător a fost înregistrat de un om și încărcat în clasificator. Puteți vedea că a fost marcat ca având o probabilitate de 2% de a fi manipulat.

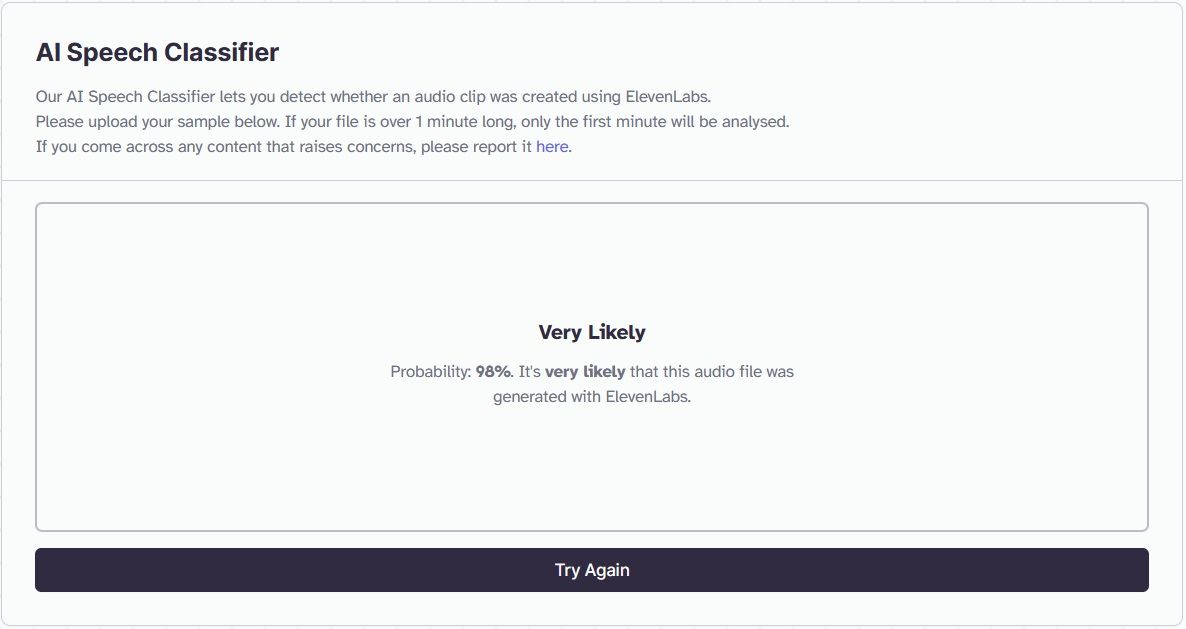

În exemplul următor, același mesaj supărător a fost produs cu un instrument de clonare a vocii AI. Pentru urechea umană, vocile nu se pot distinge. Cu toate acestea, instrumentul l-a marcat ca având o probabilitate de 98% să fie generat de AI.

Deși nu vă puteți baza 100% pe acest clasificator, acesta vă poate confirma suspiciunile cu privire la utilizarea unei voci clonate. De asemenea, ar trebui să contactați persoana iubită la un număr cunoscut pentru a confirma.

Prevenirea este cea mai bună apărare împotriva înșelătoriilor de clonare a vocii AI

Uneori, cea mai bună apărare împotriva unei escrocherii high-tech este o soluție low-tech.

Stabiliți o parolă offline, cunoscută doar de cei dragi cu familia și prietenii. În cazul unui apel frenetic, utilizarea acestei parole poate fi o modalitate sigură de a confirma identitatea apelantului.

În cele din urmă, păstrarea informațiilor private în afara rețelelor sociale este un pas uriaș pentru a vă asigura că escrocii nu pot culege suficiente informații pentru a construi o narațiune. Ține minte: dacă nu vrei să fie cunoscut de toată lumea, cel mai bine este să nu-l distribui pe rețelele sociale.