O analiză a celor mai frecvente înșelătorii prin tehnologia Deepfake.

Vom începe cu un exemplu „special” al lui „POTUS” Joe Biden:

Acesta sugerează cum ar putea arăta o înșelătorie profundă (voce) falsificată. În realitate, s-a folosit un instrument AI de clonare vocală gratuit și a durat doar câteva minute să scriu textul (folosind ChatGPT) și să-l transform în vocea (lui Biden).

Totuși, înșelătoriile deepfake pot fi mult mai complexe. Tot ce este necesar sunt câteva fotografii, clipuri video sau audio de calitate superioară ale țintei (victimei) și un procesor grafic puternic pentru a demara procesul.

Scopul acestui articol nu este să analizăm modul de creare a materialelor video deepfake, nici cum să le identificăm.

Mai degrabă, vom oferi o scurtă introducere în deepfake și vom prezenta câteva tipuri de înșelătorii de care trebuie să fim conștienți.

Ce sunt Deepfake-urile?

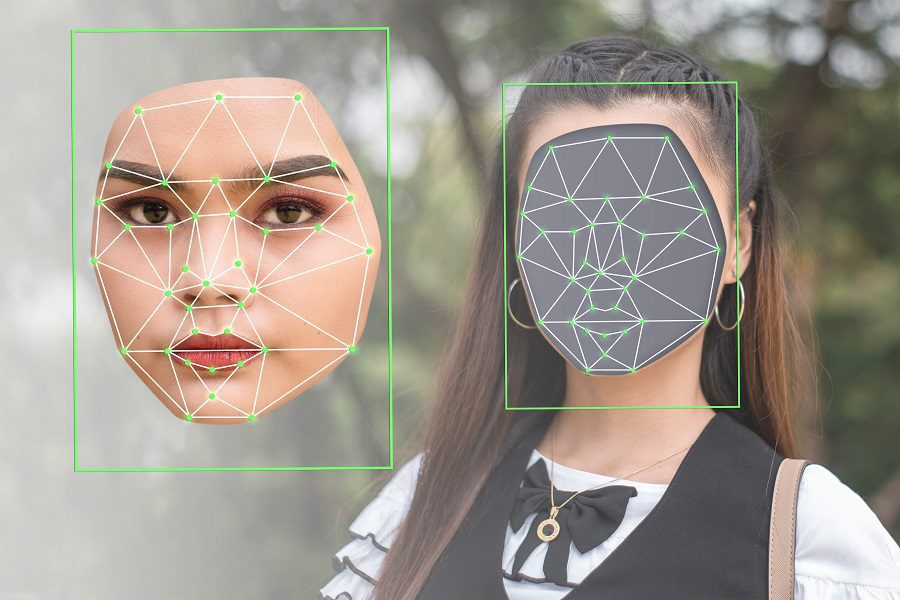

Termenul deepfake este un compus format din „deep” (de la „deep learning”, procesul prin care sunt create) și „fake” (care indică falsitatea rezultatului).

Pe scurt, algoritmii de învățare profundă sunt utilizați pentru a genera imagini, audio sau video convingătoare, pornind de la material original de înaltă rezoluție.

Acesta este un exemplu clasic de deepfake și este relativ convingător. Cu toate acestea, are deja cinci ani, iar tehnologia evoluează într-un ritm rapid.

Dar nu este întotdeauna vorba de divertisment sau de demonstrarea abilităților AI. Un exemplu grav este cel în care „Dl. Volodymyr Zelensky” este rugat de forțele sale să se predea în timpul războiului dintre Rusia și Ucraina.

Din păcate, acesta nu este un caz izolat. Conform Raportului Regula Forensics 2023, 37% dintre organizațiile globale s-au confruntat cu fraude vocale Deepfake, 29% cu înșelătorii video sintetice, iar 46% au trecut prin tentative de furt de identitate.

În consecință, nu este vorba doar de distracție. Tehnologia deepfake este utilizată pe scară largă pentru a răspândi dezinformarea și este folosită abuziv în diverse alte moduri, care pot fi periculoase și dăunătoare pentru victime.

În plus, combaterea conținutului deepfake nu este simplă. Acestea sunt efectele secundare ale progreselor semnificative înregistrate în domeniul tehnologiei AI și ale accesibilității publice a acestor instrumente.

Prin urmare, cea mai importantă și frecventă apărare pe care o avem este conștientizarea.

Să analizăm, așadar, câteva dintre tipurile de înșelătorii deepfake.

Tipuri de înșelătorii Deepfake

În funcție de conținut și țintă, înșelătoriile deepfake pot fi clasificate în diverse categorii, cum ar fi:

- Falsificarea identității video

- Interviuri false

- Știri false

- Fraude vocale

- Capcane romantice

- Suport Clienți fals

- Mărturii false

Secțiunile următoare vor analiza aceste tipuri de înșelătorii în detaliu.

Falsificarea identității video

Aceasta este o înșelătorie deepfake cunoscută, în care vedem un material video fabricat, care pare să fie o persoană cu notorietate. Victimele tipice sunt liderii de țări (cum ar fi deepfake-ul Obama), starurile de la Hollywood sau directorii executivi ai unor companii renumite.

Disponibilitatea publică a imaginilor, discursurilor etc., îi face ținte ușoare, deoarece instrumentele de creare a videoclipurilor deepfake funcționează bine cu o varietate de date, ilustrând diverse emoții, unghiuri faciale, condiții de iluminare, fundaluri și altele.

Scopul acestei falsificări de identitate poate fi divertismentul, șantajul, motivația politică, defăimarea sau altele.

În cazuri rare, s-ar putea vedea materiale video deepfake cu membrii familiei care cer bani sau acces la bunuri de valoare.

Interviuri false

Este de la sine înțeles că interviurile false care utilizează tehnologia deepfake vizează posturile de lucru la distanță, de acasă. Aceste înșelătorii se bazează pe tehnologia deepfake în timp real, prin intermediul aplicațiilor de conferințe video, precum Zoom.

Pe lângă faptul că obține un candidat nepotrivit, compania țintă riscă să-și expună activele unei persoane frauduloase. Și, în funcție de relațiile companiei, acest lucru poate afecta nu doar resursele companiei, dar poate pune în pericol și interesele naționale.

Un scop mai simplu al interviurilor deepfake ar putea fi obținerea de plăți în monede valoroase.

Pe de altă parte, escrocii pot percepe candidaților nevinovați o taxă de interviu pentru a-i pune față în față cu „magnatul din industrie” pentru mult-râvnita oportunitate de carieră.

Știri false

Cea mai răspândită înșelătorie deepfake sunt știrile false. Astfel de campanii de dezinformare online pot fi fatale în situații dificile, cum ar fi revoltele sau războaiele.

În plus, ele pot defăima personalități publice atunci când replica deepfake face comentarii pe care nu le-au făcut niciodată în realitate.

Rețelele sociale și platformele de streaming, precum YouTube, contribuie la răspândirea rapidă a acestor știri false. În cele din urmă, se creează o atmosferă în care utilizatorii obișnuiți devin confuzi cu privire la autenticitatea a tot ceea ce văd.

Fraude vocale

Asemănătoare cu videoclipurile și imaginile deepfake, vocea sintetică este un alt instrument din arsenalul acestor trucuri tehnologice.

Într-un caz recent, Jennifer DeStefano, o rezidentă din Arizona, a auzit-o pe fiica sa de 15 ani plângând la telefon, în timp ce o voce masculină a cerut 1 milion de dolari pentru eliberarea acesteia. Mama era convinsă că fiica ei este în pericol. Înainte să se gândească să plătească, o prietenă a sunat-o pe soțul ei, confirmând că fiica ei este în siguranță.

Doamna DeStefano a relatat mai târziu că a crezut în totalitate vocea, nu doar sunetul acesteia, ci și tonul general, care se potrivea exact cu felul în care vorbea de obicei fiica ei.

Aceasta este clonarea vocii, care se realizează cu ajutorul unor mostre audio brute de la sursă.

Capcane romantice

Conform definiției clasice, capcana romantică presupune atragerea unei persoane într-o relație, cu scopul de a obține informații confidențiale. Aceste capcane vizează, de obicei, persoanele importante, cum ar fi membrii armatei, înalții funcționari guvernamentali, politicienii și alții.

Cu tehnologia deepfake, aceste capcane romantice sunt în principal online și pot fi executate de oricine, la scară largă. Victimele pot primi cereri de relație de la parteneri atractivi pe rețelele sociale, care devin rapid intime, cu scopul de a obține bani sau informații.

Aceste înșelătorii deepfake sunt, de obicei, operațiuni bine puse la punct, care se desfășoară treptat înainte de a întinde capcana finală.

Suport Clienți fals

Înșelătoriile prin intermediul suportului tehnic sunt foarte comune. Poate ați auzit despre escrocherii în care un „reprezentant Microsoft” vă cere să plătiți pentru a rezolva problemele „grave” ale computerului dumneavoastră.

Înainte de deepfake, accentul sau modul de vorbire neobișnuit le dădeau de gol pe aceste persoane rău intenționate. Dar acum, escrocii au superputeri AI, care pot înșela cu ușurință utilizatorii nevinovați, convingându-i că vorbesc cu adevărat cu un reprezentant legitim al companiei.

Mărturii false

Mulți dintre noi citim recenziile clienților înainte de a cumpăra un produs. De asemenea, verificarea mărturiilor video este un alt obicei de cumpărături care s-a dovedit util până acum.

Acest tip de înșelătorie deepfake va convinge mai mulți oameni să susțină un produs de proastă calitate, va modifica deciziile de cumpărare și va irosi banii și timpul clienților.

Sunt mult mai multe!

Ce mai găsim pe internet, în afară de text?

Răspunsul este: clipuri video, imagini și audio. Toate acestea pot fi manipulate cu ajutorul tehnologiei AI, ceea ce face ca internetul să fie un teren propice pentru fraude, într-un viitor apropiat. Mai mult, crearea materialelor deepfake devine din ce în ce mai ușoară, ceea ce face dificil pentru un utilizator mediu de internet să fie „corect” informat.

Într-o astfel de situație, în care aproape nimic nu împiedică utilizarea pe scară largă a acestei tehnologii, ar trebui cel puțin să încercăm să ne menținem la curent.

PS: În ceea ce privește aplicațiile sale distractive, există diverse aplicații deepfake pentru a crea cele mai amuzante meme pentru a invada rețelele sociale.