Chatbot-urile există de ani de zile, dar creșterea modelelor de limbă mari, cum ar fi ChatGPT și Google Bard, a dat industriei chatbot-urilor o nouă viață.

Milioane de oameni folosesc acum chatbot-uri AI în întreaga lume, dar există câteva riscuri și preocupări importante privind confidențialitatea de care trebuie să țineți cont dacă doriți să încercați unul dintre aceste instrumente.

Cuprins

1. Colectarea datelor

Majoritatea oamenilor nu folosesc chatbot-uri doar pentru a saluta. Chatboții moderni sunt proiectați să proceseze și să răspundă la întrebări și solicitări complexe, utilizatorii incluzând adesea multe informații în solicitările lor. Chiar dacă pui doar o întrebare simplă, nu vrei cu adevărat să depășească conversația ta.

Conform Secțiunea de asistență a OpenAI, puteți șterge jurnalele de chat ChatGPT oricând doriți, iar acele jurnale vor fi apoi șterse definitiv din sistemele OpenAI după 30 de zile. Cu toate acestea, compania va păstra și va examina anumite jurnale de chat dacă acestea au fost semnalate pentru conținut dăunător sau neadecvat.

Un alt chatbot AI popular, Claude, ține evidența conversațiilor tale anterioare. Centrul de sprijin al antropiei afirmă că Claude urmărește „indemnările și rezultatele tale în produs pentru a-ți oferi o experiență consecventă a produsului în timp, în conformitate cu controalele tale”. Vă puteți șterge conversațiile cu Claude, astfel încât să uite despre ce ați vorbit, dar acest lucru nu înseamnă că Anthropic vă va șterge imediat jurnalele din sistemele sale.

Acest lucru, desigur, ridică întrebarea: datele mele sunt păstrate sau nu? ChatGPT sau alți chatbot-i folosesc datele mele?

Dar preocupările nu se opresc aici.

Cum învață ChatGPT?

Pentru a oferi informații, modelele mari de limbă sunt antrenate cu cantități uriașe de date. Conform Focus pe știință, Numai ChatGPT-4 a fost alimentat cu 300 de miliarde de cuvinte de informații în timpul perioadei de antrenament. Acest lucru nu este luat direct din câteva enciclopedii. Mai degrabă, dezvoltatorii de chatbot folosesc o mulțime de informații de pe internet pentru a-și antrena modelele. Acestea pot include date din cărți, filme, articole, intrări Wikipedia, postări pe blog, comentarii și chiar site-uri de recenzii.

Rețineți că, în funcție de politica de confidențialitate a unui dezvoltator de chatbot, este posibil ca unele dintre sursele menționate mai sus să nu fie utilizate în cursuri.

Mulți au criticat ChatGPT, susținând că este ceva un coșmar în ceea ce privește confidențialitatea, că nu se poate avea încredere în ChatGPT. Deci, de ce este acesta cazul?

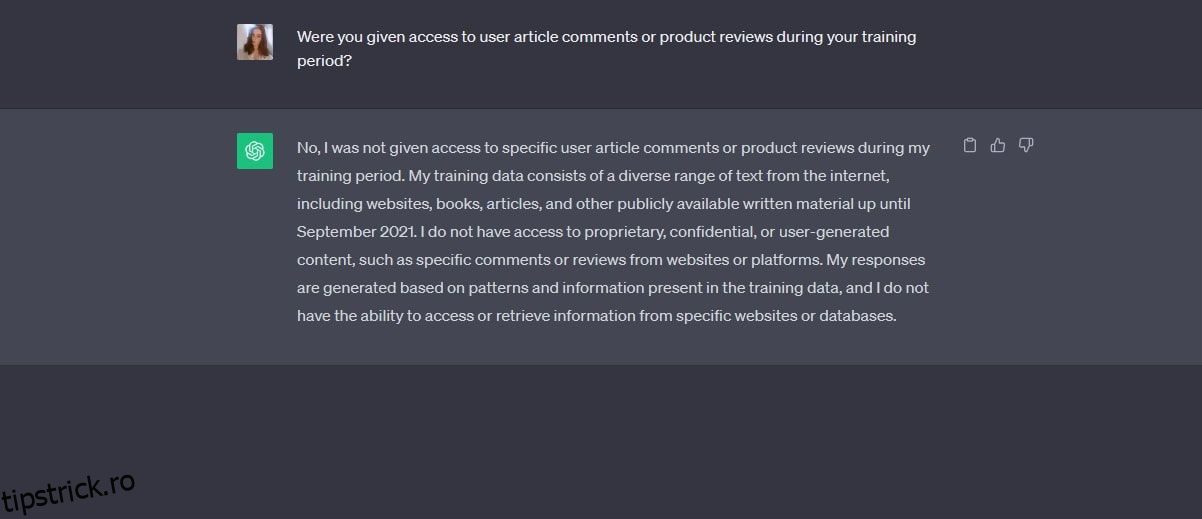

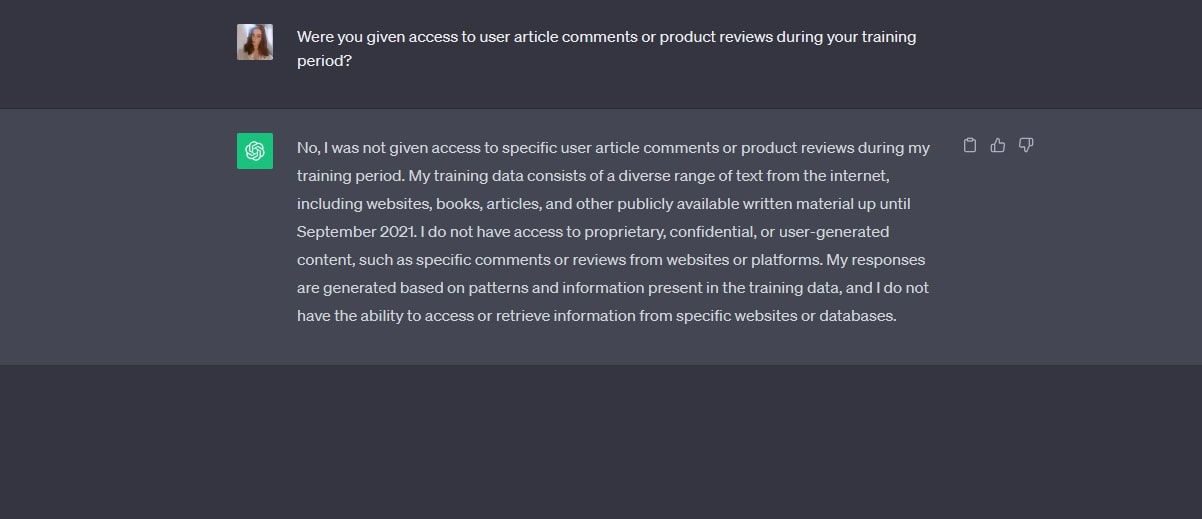

Aici lucrurile devin puțin neclare. Dacă întrebați direct ChatGPT-3.5 dacă are acces la recenzii despre produse sau comentarii despre articole, veți primi un negativ ferm. După cum puteți vedea în captura de ecran de mai jos, GPT-3.5 afirmă că nu i s-a dat acces la comentarii despre articolele utilizatorului sau recenzii despre produse în timpul instruirii sale.

Mai degrabă, a fost instruit folosind „o gamă diversă de texte de pe internet, inclusiv site-uri web, cărți, articole și alte materiale scrise disponibile publicului până în septembrie 2021”.

Dar este același caz pentru GPT-4?

Când am întrebat GPT-4, ni s-a spus că „OpenAI nu a folosit anumite recenzii ale utilizatorilor, date personale sau comentarii despre articole” în perioada de pregătire a chatbot-ului. În plus, GPT-4 ne-a spus că răspunsurile sale sunt generate din „modele din date [it] a fost instruit, care constă în principal din cărți, articole și alte texte de pe internet.”

Când am cercetat în continuare, GPT-4 a susținut că anumite conținuturi din rețelele sociale pot fi, într-adevăr, incluse în datele sale de instruire, dar creatorii vor rămâne întotdeauna anonimi. GPT-4 a declarat în mod specific că „Chiar dacă conținutul de pe platforme precum Reddit făcea parte din datele de instruire, [it doesn’t] au acces la anumite comentarii, postări sau orice date care pot fi legate înapoi la un utilizator individual.”

O altă parte notabilă a răspunsului GPT-4 este următoarea „OpenAI nu a enumerat în mod explicit fiecare sursă de date utilizată”. Desigur, ar fi greu pentru OpenAI să enumere surse în valoare de 300 de miliarde de cuvinte, dar acest lucru lasă spațiu pentru speculații.

Într-un articol Ars Technica, s-a afirmat că ChatGPT colectează „informații personale obținute fără consimțământ”. În același articol a fost menționată integritatea contextuală, un concept care se referă la utilizarea informațiilor cuiva doar în contextul în care a fost folosită inițial. Dacă ChatGPT încalcă această integritate contextuală, datele oamenilor ar putea fi în pericol.

Un alt punct de îngrijorare aici este conformitatea OpenAI cu Regulamentul general privind protecția datelor (GDPR). Acesta este un regulament aplicat de Uniunea Europeană pentru a proteja datele cetățenilor. Diverse țări europene, inclusiv Italia și Polonia, au lansat investigații asupra ChatGPT din cauza preocupărilor legate de conformitatea sa cu GDPR. Pentru o scurtă perioadă de timp, ChatGPT a fost chiar interzis în Italia din cauza preocupărilor legate de confidențialitate.

OpenAI a amenințat că se va retrage din UE în trecut din cauza reglementărilor planificate privind IA, dar acest lucru a fost retras de atunci.

ChatGPT poate fi cel mai mare chatbot AI de astăzi, dar problemele de confidențialitate ale chatbotului nu încep și nu se termină cu acest furnizor. Dacă utilizați un chatbot dubios cu o politică de confidențialitate slabă, conversațiile dvs. pot fi utilizate greșit sau informații extrem de sensibile pot fi folosite în datele sale de antrenament.

2. Furtul de date

Ca orice instrument sau platformă online, chatboții sunt vulnerabili la criminalitatea cibernetică. Chiar dacă un chatbot a făcut tot ce a putut pentru a proteja utilizatorii și datele acestora, există întotdeauna șansa ca un hacker priceput să reușească să se infiltreze în sistemele sale interne.

Dacă un anumit serviciu chatbot stochează informațiile dvs. sensibile, cum ar fi detaliile de plată pentru abonamentul dvs. premium, datele de contact sau altele similare, acestea ar putea fi furate și exploatate în cazul în care ar avea loc un atac cibernetic.

Acest lucru este valabil mai ales dacă utilizați un chatbot mai puțin sigur ai cărui dezvoltatori nu au investit într-o protecție adecvată de securitate. Nu numai că sistemele interne ale companiei ar putea fi piratate, dar propriul tău cont are șansa de a fi compromis dacă nu are alerte de conectare sau un strat de autentificare.

Acum, că chatbot-ii AI sunt atât de populari, infractorii cibernetici au apelat în mod natural la utilizarea acestei industrii pentru escrocherii. Site-urile Web și pluginurile false ChatGPT au reprezentat o problemă majoră de când chatbot-ul OpenAI a ajuns în curentul mainstream la sfârșitul anului 2022, oamenii fiind îndrăgostiți de escrocherii și oferind informații personale sub pretextul legitimității și încrederii.

În martie 2023, MUO a raportat despre o extensie falsă ChatGPT Chrome care fura autentificări Facebook. Plugin-ul ar putea exploata o ușă din spate Facebook pentru a sparge conturi de mare profil și a fura cookie-uri ale utilizatorilor. Acesta este doar un exemplu al numeroaselor servicii ChatGPT false concepute pentru a păcăli victimele neștiutoare.

3. Infecția cu malware

Dacă utilizați un chatbot umbrit fără să vă dați seama, este posibil să găsiți că chatbot-ul vă oferă link-uri către site-uri web rău intenționate. Poate că chatbot-ul v-a alertat cu privire la un cadou tentant sau a furnizat o sursă pentru una dintre declarațiile sale. Dacă operatorii serviciului au intenții ilicite, întregul scop al platformei poate fi să răspândească programe malware și escrocherii prin link-uri rău intenționate.

Alternativ, hackerii pot compromite un serviciu de chatbot legitim și îl pot folosi pentru a răspândi programe malware. Dacă acest chatbot se întâmplă să fie foarte oameni, atunci mii sau chiar milioane de utilizatori vor fi expuși la acest malware. Aplicațiile false ChatGPT au fost chiar și în Apple App Store, așa că cel mai bine este să mergeți cu atenție.

În general, nu ar trebui să faceți niciodată clic pe niciun link pe care un chatbot le oferă înainte de a-l rula printr-un site web de verificare a linkurilor. Acest lucru poate părea iritant, dar este întotdeauna cel mai bine să vă asigurați că site-ul către care sunteți condus nu are un design rău intenționat.

În plus, nu ar trebui să instalați niciodată pluginuri și extensii chatbot fără a verifica mai întâi legitimitatea acestora. Cercetați puțin în jurul aplicației pentru a vedea dacă a fost bine revizuită și, de asemenea, căutați dezvoltatorul aplicației pentru a vedea dacă găsiți ceva dubios.

Chatbot-urile nu sunt impermeabile la problemele de confidențialitate

La fel ca majoritatea instrumentelor online din zilele noastre, chatboții au fost criticați în mod repetat pentru posibilele lor capcane de securitate și confidențialitate. Fie că este vorba de un furnizor de chatbot care se ocupă de siguranța utilizatorilor sau de riscurile continue de atacuri cibernetice și escrocherii, este esențial să știți ce colectează serviciul dvs. de chatbot pentru dvs. și dacă a folosit măsuri de securitate adecvate.